VIDEO.- Brutal robo a una abuela y sus nietos en Barrio Norte: “Los golpearon y los ataron”

VIDEO.- Brutal robo a una abuela y sus nietos en Barrio Norte: “Los golpearon y los ataron”

FOTOS | Arrancó en Plaza Moreno la insólita convocatoria de pelados que revolucionó a La Plata

El PRO tras la centralidad perdida, la ruidosa mano de Karina y el pacto peronista

Cayó el sospechoso de los ataques antisemitas en La Plata: tenía armas y una bomba molotov

Mitos y verdades sobre el “chip sexual”: entre la evidencia clínica y los riesgos del boom hormonal

La agenda deportiva del domingo se carga de fútbol: partidos, horarios y TV

Quién era Serena Andreatta, la joven argentina que murió tras el vuelco de un micro en Australia

La agenda de espectáculos para disfrutar con todo este domingo en La Plata

Once años de juicios por jurados; en La Plata se hicieron 37: avances y cuentas pendientes

Domingo fresco y con viento en La Plata: anticipan heladas para el arranque de la semana

Milei revivió su batalla contra el "wokismo" y tildó de "limitados" a sus críticos

La Plata, capital de las pensiones: un fenómeno que no pierde su vigencia

VIDEO. Los jóvenes platenses sí escriben: entre la voz propia y la literatura colectiva

Por qué los expertos consideran al Gran La Plata una zona que favorece al hantavirus

“Rada”: el desafío de bucear en las complejidades de Willy Wonka

Lo que no se nombra, no se mide; y lo que no se mide, difícilmente se corrige

Más que Súper RIGI, hay que terminar con el cepo y crear el Súper IVA

El cierre de la semana fue muy complejo para el mundo y no tanto para la Argentina

Keynes 1.0: por qué la austeridad no siempre genera crecimiento

Estimado lector, muchas gracias por su interés en nuestras notas. Hemos incorporado el registro con el objetivo de mejorar la información que le brindamos de acuerdo a sus intereses. Para más información haga clic aquí

Los expertos analizan virtudes y riesgos de “la próxima gran cosa” en materia de súper computación. “Deep fakes”, armas autónomas y cómo podría irse todo al diablo

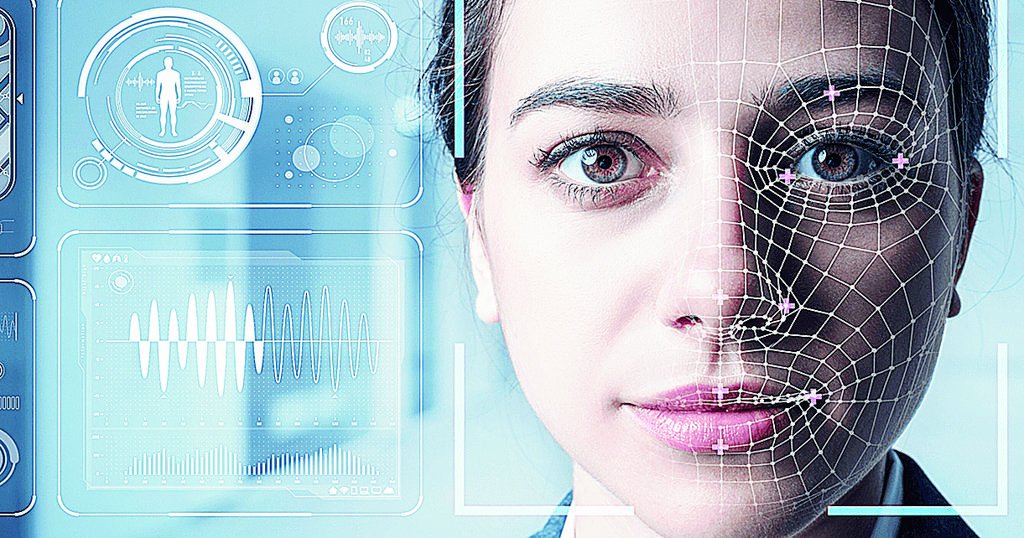

EL RECONOCIMIENTO FACIAL COMO ESTRATEGIA DE VIGILANCIA Y LA POSIBILIDAD DE ADULTERAR VIDEOS, EN LA MIRA

El chatbot -algo así como ”robot conversador”- del programa ChatGPT, siglas angloparlantes de “Chat Generativo Previamente Entrenado”, es la comidilla del momento. Está en boca de todos, y se da maña para responder con coherencia casi todo; sorprendió gratamente al mismísimo BiIl Gates, y es el último grito de la “inteligencia artificial”. En medio de inversiones de alto perfil, la IA parece estar a punto de saltar de los monitores para conquistar el mundo... una idea que muchos consideran bastante inquietante.

En las últimas semanas, aplicaciones con IA aprobaron exámenes de Derecho en la Universidad de Minnesota, lograron un master en administración en la prestigiosa escuela Wharton, y superaron con holgura la prueba de ingreso a Medicina en España.

También sobrepasaron la exigente vara que propuso el propio Gates a sus programadores: una IA acertó 59 preguntas sobre 60 en el durísimo examen de Biología AP Bio, y escribió seis “sobresalientes” respuestas a preguntas abiertas de ese test. Cono consecuencia, el 23 de enero pasado, Microsoft anunció la tercera fase de su sociedad con OpenAI, un acuerdo de inversión “plurianual y multibillonario” para “acelerar” los descubrimientos del laboratorio de investigación fundado en 2015 por San Altman como entidad sin fines de lucro -condición que ya no es tal-. Es la apuesta mas fuerte de la empresa de Gates en este momento: “estamos ante el avance tecnológico más importante desde la interfaz gráfica de usuario” sentenció el padre de Windows.

Hasta ahora, todo parecía color de rosa. Pero las espinas no tardaron en aparecer. El megamillonario Elon Musk, junto a decenas de expertos mundiales, científicos, ejecutivos, filósofos y sociólogos, firmó un llamado a hacer una pausa de seis meses en la investigación sobre inteligencias artificiales (IA) más potentes que el ChatGPT 4, última versión del bot hasta el momento, por advertir “grandes riesgos para la humanidad”. Por medio de la solicitud, publicada en futureoflife.org, el dueño de Twitter y fundador de SpaceX y Tesla, junto al historiador Yuval Noah Harari, el co-fundador de Apple Steve Wozniak, miembros del laboratorio de AI DeepMind de Google, el director de Stability AI, Emad Mostaque, expertos y académicos estadounidenses de e ingenieros ejecutivos de Microsoft, abogan por una moratoria “hasta que se establezcan sistemas de seguridad con nuevas autoridades reguladoras, vigilancia de los sistemas de IA, técnicas que ayuden a distinguir entre lo real y lo artificial, e instituciones capaces de hacer frente a la dramática perturbación económica y política, especialmente para la democracia) que causará la IA”.

El propio director de Open AI, Sam Altman, ha reconocido tener algo de miedo a que su creación sea usada para “desinformación a gran escala” y “ciberataques”, y admite que “la empresa necesita tiempo para adaptarse”. Los firmantes del petitorio se preguntan “¿debemos permitir a las máquinas inundar nuestros canales de información con propaganda y mentiras? ¿Debemos automatizar todos los trabajos, incluidos los gratificantes? ¿Debemos arriesgarnos a perder el control de nuestra civilización?”, y responden: “estas decisiones no deben delegarse en líderes tecnológicos no electos”.

Un relevamiento encargado por Open AI midió recientemente el impacto de los modelos Generative Pre-trained Transformer (GPT) en el mercado laboral de los EEUU, y concluyó que “en torno al 80 por ciento de la fuerza laboral podría verse afectada en al menos el 10% de sus tareas debido a la introducción de las GPT”. Además, se estimó que “un 19% de los trabajadores podría ver afectado al menos el 50% de sus tareas, con una particularidad: los empleos de mayores ingresos podrían ser los más expuestos al riesgo de ver reducidos sus salarios”. Entre ellos, algunos del los más calificados, como programadores, redactores, abogados, contadores, ingenieros, auditores, matemáticos, diseñadores web, y empleados administrativos.

LE PUEDE INTERESAR

Un fenómeno muy presente en las escuelas

El documento explica que mientras más educación necesite un empleo, más posibilidades hay de que sea sustituido por una inteligencia artificial. Los trabajos con menor demanda de capacitación y más físicos, al contrario de la creencia popular, no serán eliminados. “Nuestro análisis sugiere que las personas con licenciaturas, másters y títulos están más expuestas a las GPT” admiten en la empresa: “en cambio, labores como albañiles, mecánicos, operadores de maquinaria agrícola, cocineros, atletas, lavaplatos, carpinteros, carniceros, excavadores, operadores de minas, etcétera, corren menores riesgos”. Max Tegmark, profesor de Física e Investigación de IA en el MIT de Boston, es uno de los más importantes defensores y promotores del uso positivo de la tecnología como presidente del Future of Life Institute. Autor de varios ‘best sellers’, advierte que “todos, no solo los científicos, empresarios y militares, debemos preguntarnos qué podemos hacer para mejorar las posibilidades de obtener los beneficios y evitar los riesgos de la IA”.

“Tenemos el potencial para amplificar la inteligencia humana y alcanzar lo aún impensables” destaca Tegmark: “Por ejemplo, el cáncer no es incurable, sino que todavía no tenemos la inteligencia suficiente para curarlo. Podríamos achicar la pobreza, moderar el cambio climático... Si tenemos gente enfocada en colaborar para encontrar soluciones, las encontraremos. Pero supongamos que esta tecnología cae en manos de alguno de los regímenes dictatoriales del mundo, y el líder cuenta con un sistema híper sofisticado para vigilar, denunciar y reprimir... La clave está en crear una línea moral que rechace el uso negativo de la tecnología. Por ejemplo, si las armas biológicas hoy no fueran ilegales, la gente igual tiene claro que son asquerosas. Es como si le ofrecieran trabajo a alguien en una página web de pornografía infantil”.

El docente reconoce que “algunas carreras desaparecerán, sobre todo trabajos que son repetitivos y no involucran contacto con otros humanos. Pero en casi todos los trabajos desaparecerán algunas funciones, y eso significa que en todos habrá que aprender qué está pasando con la IA. Por sobre todo, tendrá sentido para los gobiernos y las empresas generar empleos en los que la gente sea feliz. El trabajo no sólo nos da dinero, sino un propósito, amigos. Una sociedad más feliz es la que tiene humanos haciendo las cosas que disfrutan hacer”.

“Hay que parar todo hasta implementar medidas de seguridad y regulaciones”

Hace algunos años, cuatro notables científicos (Steven Hawking, Frank Wilczek, Stuart Russell y Tegmark) hicieron notar que “aunque estamos enfrentando potencialmente lo mejor -o lo peor- que le haya pasado a la humanidad, se dedica poca investigación seria a estos temas, y deberíamos cuestionarnos qué podemos hacer ya mismo para mejorar las chances de alcanzar los beneficios y evitar los riesgos”. En la misma línea, investigadores de Oxford sugieren avanzar “más lento y más seguro” en las tecnologías relacionadas con la inteligencia artificial, porque “podrían acabar con la Humanidad”. Liderado por Marcus Hutter, senior de DeepMind, Michael Cohen y Michael Osborne, el trabajo indica que una IA “demasiado inteligente” probablemente aniquilaría a los humanos. “Bajo las condiciones que hemos identificado, nuestra conclusión es mucho más sólida que la de cualquier publicación anterior: una catástrofe existencial no solo es posible, sino probable”, aseguran los científicos. Según su hipótesis, la vida en la Tierra pasará a ser una guerra entre la humanidad y las máquinas altamente desarrolladas. La humanidad trataría de satisfacer sus necesidades, producir alimentos y electricidad; mientras que la inteligencia artificial trataría de aprovechar todos los recursos para asegurar su recompensa y protegerse de los intentos de la humanidad por frenarla. La solución, según el trío, es progresar de manera lenta y precavida en las tecnologías de IA.

“La vida en la Tierra será una guerra entre la humanidad y las máquinas más sofisticadas”

La ONU, por su parte, identifica cinco grandes problemas a resolver y cuestiones a tener en cuenta: las armas autónomas; el uso fraudulento de los datos personales; los eventuales errores del reconocimiento facial; la presencia de IA como “competencia” en el mercado laboral; y su uso por parte de los jueces para predecir conductas y reincidencias en base a algoritmos y no una evaluación personalizada.

ESTA NOTA ES EXCLUSIVA PARA SUSCRIPTORES

HA ALCANZADO EL LIMITE DE NOTAS GRATUITAS

Para disfrutar este artículo, análisis y más,

por favor, suscríbase a uno de nuestros planes digitales

¿Ya tiene suscripción? Ingresar

Full Promocional mensual

$740/mes

*LOS PRIMEROS 3 MESES, LUEGO $6990

Acceso ilimitado a www.eldia.com

Acceso a la versión PDF

Beneficios Club El Día

Básico Promocional mensual

$570/mes

*LOS PRIMEROS 3 MESES, LUEGO $4500

Acceso ilimitado a www.eldia.com

Diario El Día de La Plata, fundado el 2 de Marzo de 1884.

© 2026 El Día SA - Todos los derechos reservados.

Registro DNDA Nº RL-2024-69526764-APN-DNDA#MJ Propietario El Día SAICYF. Edición Nro. 6986 Director: Raúl Kraiselburd. Diag. 80 Nro. 815 - La Plata - Pcia. de Bs. As.

Bienvenido

Estimado lector, muchas gracias por su interés en nuestras notas. Hemos incorporado el registro con el objetivo de mejorar la información que le brindamos de acuerdo a sus intereses. Para más información haga clic aquí

Ante cualquier inconveniente durante el inicio de sesión, por favor escribanos a sistemas@eldia.com

Bienvenido

Estimado lector, con sólo registrarse tendrá acceso a 80 artículos por mes en forma gratuita. Para más información haga clic aquí

DATOS PERSONALES

Ante cualquier inconveniente durante el inicio de sesión, por favor escribanos a sistemas@eldia.com

¿Querés recibir notificaciones de alertas?

Para comentar suscribite haciendo click aquí