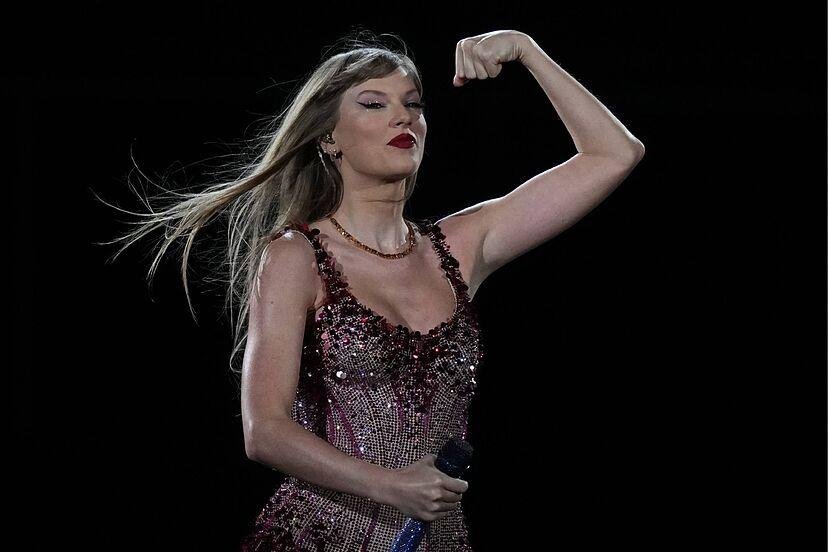

Taylor, última víctima de los “deepfake”, fotos y videos muy realistas pero creados por IA

Un ciclón frente a la costa bonaerense descargará fuertes vientos este finde en La Plata

En plena interna, Kicillof asumió en el PJ y sale a buscar afiliados

Choque y vuelco en La Plata: una camioneta terminó dada vuelta a metros del Parque Ecológico

Alpine borró un video de Colapinto cantando por las Islas Malvinas

La agenda de espectáculos para disfrutar con todo este sábado en La Plata

Micros: habría más aumento por el gasoil y cambios en los subsidios

Naturalizar la tragedia: otra muerte en moto enluta a la Región

Revés para Cristina Confirman el decomiso de una gran parte de sus bienes

VIDEO. El “cafecito” copa Barrio Norte: al paso, con pastelería y pocas mesas

Más de un siglo salvando vidas: los Bomberos Voluntarios de Berisso cumplen 102 años

Desechos cloacales y olor nauseabundo en una esquina de Gonnet

Presentaron en el Obelisco el Fórmula 1 que conducirá Colapinto mañana domingo en Palermo

El gremio de los médicos CICOP eligió autoridades hasta 2030

Quedó filmado robando una bicicleta frente a un local en Villa Elvira

Francisco Cerúndolo ganó y avanzó a tercera ronda en el Masters de Madrid

Malvinas y Argentina: qué implicaría un giro de EE UU en su apoyo al Reino Unido

La agenda deportiva de este sábado: partidos, horarios y transmisión

Masters de Madrid: Tirante dio la nota de la jornada y ganó Etcheverry

El kirchnerismo pidió la libertad de Cristina con mensajes a la interna

Cartonazo de $2.000.000 | Los números que se publicaron hoy sábado en EL DIA

Cuenta DNI: los descuentos que hay para hoy sábado 25 de abril 2026

Estimado lector, muchas gracias por su interés en nuestras notas. Hemos incorporado el registro con el objetivo de mejorar la información que le brindamos de acuerdo a sus intereses. Para más información haga clic aquí

Estados Unidos se indignó y pide control y freno para las nuevas tecnologías y su capacidad para generar contenidos problemáticos

Taylor, última víctima de los “deepfake”, fotos y videos muy realistas pero creados por IA

Que las inteligencias artificiales son poderosas, cada vez más, está claro. También que son peligrosas, y que colaboran cada vez más activamente a que sea imposible distinguir realidad y ficción. Lo que le ocurrió ayer a Taylor Swift es, apenas, el último botón de muestra de un asunto cada vez más complicado: en las redes, aparecieron una serie de imágenes pornográficas falsas de la artista, creadas por las IA.

Por eso, ayer, fanáticos de la cantante pop Taylor Swift, políticos estadounidenses e incluso la Casa Blanca expresaron su indignación por las imágenes, que se volvieron virales en la red social X.

Una de esas imágenes fue vista 47 millones de veces en la plataforma de Elon Musk antes de su eliminación. Según medios estadounidenses, la publicación estuvo visible en la plataforma durante aproximadamente 17 horas.

Las imágenes pornográficas “deepfake” -falsas pero extremadamente realistas- de celebridades no son nuevas. Pero a activistas y autoridades les preocupa que herramientas fáciles de usar que emplean inteligencia artificial (IA) generativa creen una avalancha incontrolable de contenido tóxico o dañino.

El ataque a Swift, la segunda artista más escuchada del mundo en la plataforma Spotify después del rapero canadiense Drake, podría arrojar nueva luz sobre el fenómeno.

“El único lado positivo de que esto le haya sucedido a Taylor Swift es que probablemente tenga suficiente poder para aprobar una legislación que lo elimine. Ustedes están enfermos”, escribió la influencer Danisha Carter en X.

LE PUEDE INTERESAR

La novelita de la semana: qué pasa con Vigna y Marzol

LE PUEDE INTERESAR

Snoop Dogg debuta en las películas con una de fútbol (americano)

Incluso la Casa Blanca expresó su preocupación sobre el tema. “Estamos alarmados por las noticias sobre la circulación de estas imágenes falsas”, dijo a los periodistas Karine Jean-Pierre, secretaria de prensa del presidente Joe Biden.

“Desafortunadamente, con demasiada frecuencia notamos que la falta de aplicación de la ley tiene un impacto desproporcionado en las mujeres y las niñas, los principales blancos del acoso en línea”, añadió.

X, la vieja Twitter, es una de las plataformas de contenido pornográfico más grandes del mundo, afirman algunos analistas, ya que sus políticas sobre desnudez son más flexibles que las de Facebook o Instagram, propiedad de Meta.

Un estudio de 2019 estimó que el 96% de los vídeos del tipo “deepfake” eran pornográficos

Apple y Google tienen la potestad de intervenir para controlar los contenidos que circulan en las aplicaciones mediante las reglas que imponen sus sistemas operativos móviles, pero hasta ahora ambos han tolerado esta situación en X.

En respuesta, en un comunicado, X aclaró que “publicar imágenes de desnudos no consensuales (NCN) está estrictamente prohibido” en su plataforma. “Tenemos una política de tolerancia cero hacia ese contenido”.

La red social afirmó que estaba “eliminando activamente todas las imágenes identificadas y tomando las medidas apropiadas contra las cuentas responsables de publicarlas”.

Además, resaltó que estaba “vigilando de cerca la situación para garantizar que cualquier otra violación se aborde de inmediato y se elimine el contenido”.

Mientras tanto, los representantes de Swift no respondieron a diversas solicitudes de declaraciones ante el espinoso asunto.

Esta es apenas la última de una serie de problemas creado por los deepfakes, que podrían, por ejemplo, inculpar a alguien de cometer un crimen sin que haya demasiadas herramientas para controlarlo.

Al respecto, Yvette Clarke, congresista demócrata de Nueva York que ha respaldado una legislación para luchar contra las fotos pornográficas falsas, resaltó que “con los avances en IA, crear deepfakes es más fácil y barato”.

De su lado, el legislador republicano estadounidense Tom Kean, advirtió que “la tecnología de inteligencia artificial está avanzando más rápido que las barreras necesarias”. “Ya sea que la víctima sea Taylor Swift o cualquier joven de nuestro país, debemos establecer salvaguardias para combatir esta tendencia alarmante”, añadió.

Un estudio de 2019 estimó que el 96% de los vídeos del tipo “deepfake” eran pornográficos. Según una investigación citada por la revista Wired, en los primeros nueve meses de 2023 se subieron 113.000 vídeos “deepfake” a los sitios web pornográficos más populares.

ESTA NOTA ES EXCLUSIVA PARA SUSCRIPTORES

HA ALCANZADO EL LIMITE DE NOTAS GRATUITAS

Para disfrutar este artículo, análisis y más,

por favor, suscríbase a uno de nuestros planes digitales

¿Ya tiene suscripción? Ingresar

Full Promocional mensual

$740/mes

*LOS PRIMEROS 3 MESES, LUEGO $6990

Acceso ilimitado a www.eldia.com

Acceso a la versión PDF

Beneficios Club El Día

Básico Promocional mensual

$570/mes

*LOS PRIMEROS 3 MESES, LUEGO $4500

Acceso ilimitado a www.eldia.com

Diario El Día de La Plata, fundado el 2 de Marzo de 1884.

© 2026 El Día SA - Todos los derechos reservados.

Registro DNDA Nº RL-2024-69526764-APN-DNDA#MJ Propietario El Día SAICYF. Edición Nro. 6986 Director: Raúl Kraiselburd. Diag. 80 Nro. 815 - La Plata - Pcia. de Bs. As.

Bienvenido

Estimado lector, muchas gracias por su interés en nuestras notas. Hemos incorporado el registro con el objetivo de mejorar la información que le brindamos de acuerdo a sus intereses. Para más información haga clic aquí

Ante cualquier inconveniente durante el inicio de sesión, por favor escribanos a sistemas@eldia.com

Bienvenido

Estimado lector, con sólo registrarse tendrá acceso a 80 artículos por mes en forma gratuita. Para más información haga clic aquí

DATOS PERSONALES

Ante cualquier inconveniente durante el inicio de sesión, por favor escribanos a sistemas@eldia.com

¿Querés recibir notificaciones de alertas?

Para comentar suscribite haciendo click aquí