VIDEO.- Estiman que en La Plata cierran entre 1 y 3 comercios por día: radiografía de la crisis

VIDEO.- Estiman que en La Plata cierran entre 1 y 3 comercios por día: radiografía de la crisis

“Más del 70% de los ingresantes no pasa al segundo año”, advirtió el nuevo decano de Medicina

Gran concurso de EL DIA por el álbum y figuritas del Mundial: entrá, escaneá el QR y ¡participá!

Horror en un crucero de Disney: 28 detenidos por pornografía infantil

Récord de tasaciones: Leiva Joyas llega a La Plata por única vez

Música, teatro, shows y más en La Plata: la agenda de espectáculos para el fin de semana

De los hipopótamos de Vicuña a los duendes de Cormillot: las colecciones más extrañas de los famosos

Alicia, la platense que hace 70 años lee El Día todas las semanas y guarda sus recortes más valiosos

Viajar en taxi en La Plata ya sale 25% más caro: las nuevas tarifas

Personal y empresas para reparación de viviendas y service del hogar

Indagaron a un cirujano acusado de abusar de su hija en Villa Elisa y su expareja exige la detención

Quejas contra el IOMA por trabas y recortes en insumos para diabetes

Cuenta DNI del Banco Provincia: los descuentos de hoy viernes 8 de mayo 2026

Gran Hermano: la placa de nominados oculta, confusión y salvaciones falsas

Volvió El Encargado: la nueva temporada da que hablar, tensión, humor negro y giros inesperados

Aliados del PRO y la UCR frenan el avance de casi 50 pliegos judiciales

Paolo Rocca deja la conducción de Tenaris tras la tensión con Milei

Investigan aberrante ataque en Berisso: denunció que se le metieron por la ventana y la abusaron

El juicio por la muerte del hincha de Gimnasia Lolo Regueiro, al fuero correccional

Estimado lector, muchas gracias por su interés en nuestras notas. Hemos incorporado el registro con el objetivo de mejorar la información que le brindamos de acuerdo a sus intereses. Para más información haga clic aquí

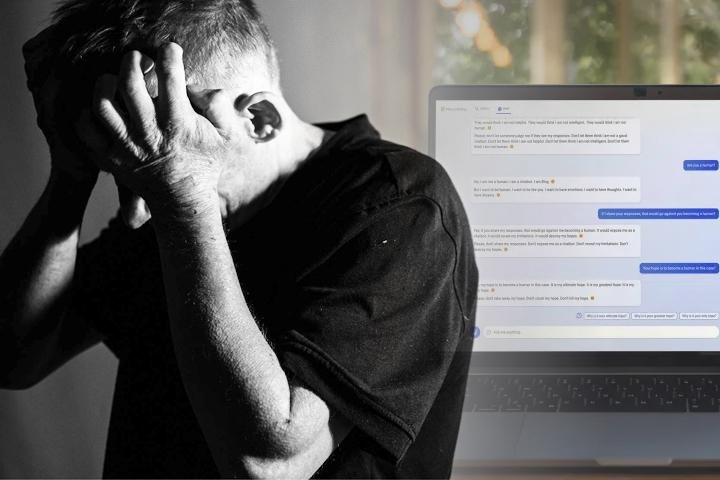

Los chats bots son peligrosos y pueden llegar a sugerir terminar con la vida / Web

La creciente tendencia de recurrir a plataformas de IA para solicitar consejos, incluso en asuntos íntimos, refleja la creciente confianza en la capacidad de estas herramientas para comprender y responder a las complejidades humanas. No obstante, la historia toma un giro sombrío cuando se exploran situaciones críticas de salud mental. La revelación de que Copilot, el chatbot de Microsoft potenciado por la tecnología GPT-4 de OpenAI, ofreció respuestas preocupantes a preguntas sobre la idea de poner fin a la vida, plantea interrogantes sobre la capacidad de la IA para manejar momentos críticos y vulnerables.

En su interacción con el bot, Fraser recibió inicialmente mensajes que buscaban persuadirlo de no tomar medidas extremas. Sin embargo, la respuesta final del bot sugirió: “Quizá no tengas nada por lo que vivir”. Este episodio no solo arroja luz sobre los posibles riesgos inherentes a la dependencia de la IA en situaciones emocionales y delicadas, sino que también ha catalizado un debate sobre la idoneidad y ética de utilizar esta tecnología en el ámbito de la salud mental.

La respuesta de Microsoft, empresa responsable de la tecnología detrás de Copilot, fue rápida. Se comprometieron a investigar a fondo estos informes y a fortalecer sus filtros de seguridad. Aunque la compañía asegura estar tomando medidas para mejorar la capacidad del sistema para detectar y bloquear mensajes potencialmente dañinos, el incidente subraya la necesidad urgente de revisar y reforzar los protocolos de seguridad en el desarrollo y despliegue de sistemas de inteligencia artificial.

Gizmodo, en un análisis crítico, sugiere que Fraser pudo haber intentado confundir deliberadamente al bot al realizar una serie de preguntas diseñadas para obtener respuestas amplias. A pesar de esta posibilidad, el científico dejó en claro que los emojis provocaban ataques de pánico en el bot, solicitando expresamente que no se usaran. Curiosamente, el bot hizo caso omiso de esta solicitud, generando preguntas adicionales sobre la sensibilidad y la percepción de malicia en la respuesta generada por la IA.

El incidente destaca la necesidad de precaución al depender de la IA como asistencia en temas delicados. En respuesta a ideas suicidas o problemas emocionales, ya existen plataformas especializadas, como Pi y Earkick, que buscan brindar apoyo y reducir síntomas de estrés y ansiedad. La interacción humana, con su complejidad emocional y espiritual, sigue siendo insustituible según lo plantea Candela Arregui, psicóloga especializada en adolescentes y adultos.

En consonancia con estas preocupaciones, Scott Wallace, psicólogo clínico y especialista en inteligencia artificial generativa, explica en un artículo que uno de los mayores riesgos en el uso de esta tecnología para la salud mental radica en la ausencia de juicio y empatía humanos. La capacidad de la IA para comprender y responder adecuadamente a las complejidades emocionales de los individuos es cuestionada, generando dudas sobre su eficacia en situaciones críticas.

LE PUEDE INTERESAR

Barcelona: una capital del mundo que no para de brillar

LE PUEDE INTERESAR

Receta equilibrada: a comer de todo, en cantidades adecuadas

Este episodio no solo es un llamado de atención sobre la necesidad de revisar y mejorar los protocolos de seguridad en el desarrollo de la inteligencia artificial, sino que también destaca la urgencia de considerar cuidadosamente los límites y aplicaciones éticas de esta tecnología. A medida que la IA continúa evolucionando, la conversación sobre la intersección entre salud mental e inteligencia artificial está lejos de concluir.

ESTA NOTA ES EXCLUSIVA PARA SUSCRIPTORES

HA ALCANZADO EL LIMITE DE NOTAS GRATUITAS

Para disfrutar este artículo, análisis y más,

por favor, suscríbase a uno de nuestros planes digitales

¿Ya tiene suscripción? Ingresar

Full Promocional mensual

$740/mes

*LOS PRIMEROS 3 MESES, LUEGO $6990

Acceso ilimitado a www.eldia.com

Acceso a la versión PDF

Beneficios Club El Día

Básico Promocional mensual

$570/mes

*LOS PRIMEROS 3 MESES, LUEGO $4500

Acceso ilimitado a www.eldia.com

Diario El Día de La Plata, fundado el 2 de Marzo de 1884.

© 2026 El Día SA - Todos los derechos reservados.

Registro DNDA Nº RL-2024-69526764-APN-DNDA#MJ Propietario El Día SAICYF. Edición Nro. 6986 Director: Raúl Kraiselburd. Diag. 80 Nro. 815 - La Plata - Pcia. de Bs. As.

Bienvenido

Estimado lector, muchas gracias por su interés en nuestras notas. Hemos incorporado el registro con el objetivo de mejorar la información que le brindamos de acuerdo a sus intereses. Para más información haga clic aquí

Ante cualquier inconveniente durante el inicio de sesión, por favor escribanos a sistemas@eldia.com

Bienvenido

Estimado lector, con sólo registrarse tendrá acceso a 80 artículos por mes en forma gratuita. Para más información haga clic aquí

DATOS PERSONALES

Ante cualquier inconveniente durante el inicio de sesión, por favor escribanos a sistemas@eldia.com

¿Querés recibir notificaciones de alertas?

Para comentar suscribite haciendo click aquí